AI 代理人正快速從令人驚豔的示範,走向能代表你在系統上執行動作的實用工具,而 OpenClaw 則是引發最近討論熱潮的專案之一。你可能也聽過這套軟體以 Clawdbot 或 Moltbot 等名稱出現,這些都是其開發者、奧地利程式設計師 Peter Steinberger 在不同開發階段使用的名稱。

它被宣傳為能代勞的個人助理、可以替你操作軟體,但同時也帶來了關於存取權與安全性的重大疑問。

- AI 代理人是具執行能力的 AI 系統,而不只是對話型工具。

- 像 OpenClaw 這類工具顯示了自我託管(self-hosted)AI 代理人的強大潛力。

- 當代理人處理不受信任的輸入時,這種能力會引入全新的安全風險。

- 提示注入(prompt injection)是針對 AI 代理人的主要威脅,甚至比針對聊天機器人的風險更高。

- 持久記憶會放大錯誤並延長攻擊影響。

- AI 代理人雖然強大,但對大多數消費者來說並非安全的預設選項。

為什麼 OpenClaw 會成為焦點?

OpenClaw 之所以引起注意,是因為它代表了 AI 從「回答問題」走向「能在真實系統上執行任務、使用其他軟體」的轉變。這樣的潛在資安問題也讓更多資安圈的人開始關注 OpenClaw。那麼,OpenClaw 為何對開發者與高階使用者有吸引力?

OpenClaw 的特色在於它能採取實際行動,而不只是產生文字或建議。它不再只是告訴你該怎麼做,而是能自己去做。這項技術可以替你開啟應用程式、發送訊息、移動檔案、執行指令,並直接與系統互動。

這種程度的自動化正吸引注意力。開發者與進階用戶視系統層級的控制為減少重複工作或自動化流程的手段。能夠「直接幫你完成工作」而不僅是在旁協助的代理人,對許多人來說是極具吸引力的構想。

正是這種可操作性的承諾,讓 OpenClaw 從小眾專案迅速進入更廣泛的討論。

這件事為何超越了 OpenClaw 本身的重要性

OpenClaw 提供了一個清楚的範例,顯示了更廣泛趨勢:AI 代理人正從單純回應與建議,走向能夠實際執行的系統。

當這類技術發展時,關於濫用的問題便無法迴避。OpenClaw 指出了 AI 未來的可能去向,使得相關討論不再侷限於單一專案,並促成關於這些代理人應如何被管控的持續討論。它們能被信任嗎?

什麼是 AI 代理人?它與其他 AI 工具有何不同?

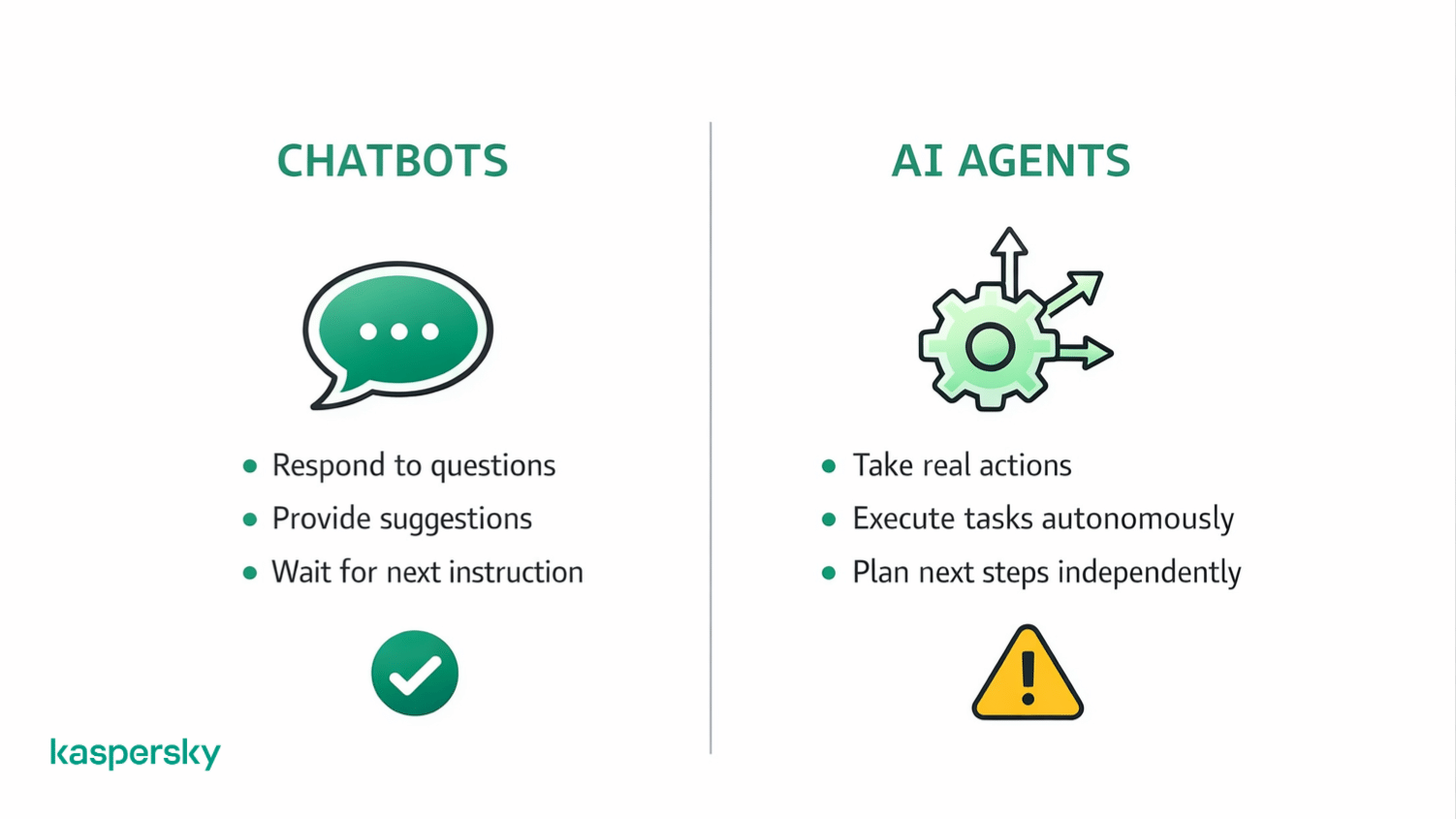

AI 代理人不是只提供文字或語音回應的系統。它們能夠主動規劃步驟並執行行動以達成目標。它們不僅停留在給出建議,還會決定下一步該做什麼並執行。

代理人能觀察情境並採取行動。這與大多數僅回應提示、等待下一道指令的 AI 工具不同。早期範例包括像 Manus(現為 Meta 所擁有)的任務執行型代理人,示範了代理人如何從聊天延伸到實際操作。它可以提供資料分析,甚至主動撰寫程式碼來解決問題,而不需要每一步都明確指示,因而減少了人為介入。

OpenClaw 建立在這類能執行的 AI 概念上,但以更直接且更強大的方式應用在系統與軟體互動上。

OpenClaw 是典型的 AI 代理人,還是更進階的例子?

OpenClaw 屬於 AI 代理人範疇,但它的實作比許多大眾熟悉的工具更強大。

這個 AI 工具能規劃任務並在沒有持續輸入的情況下採取行動。OpenClaw 能直接與其他軟體和作業系統互動,而不僅限於 API 或其他受限工具。更廣的存取權讓它更實用,也提高了風險與安全性的重大性。

為何自我託管(self-hosted)的 AI 代理人有所不同

自我託管的 AI 代理人是在你自己的系統上本地運行,而不是在遠端服務上執行。這讓使用者在設定與行為上擁有更多掌控,但同時也將更多責任放在使用者身上。

當代理人擁有本地存取權時,安全性取決於它的設定方式、所被授予的權限以及監控措施。更多的掌控通常伴隨更高的風險。

近來的專案也顯示「自我託管」這個概念正在改變。例如,Moltbot(先前稱為 Clawdbot)現在可以透過 Cloudflare 的開源 Moltworker 來執行。這種方式完全消除了需要專用本地硬體的必要,改以在受管平台上運行代理人。

這降低了入門門檻並簡化了設定,但也改變了控制權的所在。當代理人在雲端基礎設施上運行時,安全性不只取決於代理人本身,也取決於存取控制、平台如何處理資料與權限等因素。

舉例來說,使用者可能只想讓代理人讀取電子郵件,但若雲端設定沒有明確關閉發信權限,代理人便可能同時具備寄信的能力。

AI 代理人與像 ChatGPT 這類聊天機器人有何不同?

聊天機器人(例如 ChatGPT)是回應;而 AI 代理人是行動。

聊天機器人可以提供建議或解說;AI 代理人則能主動開啟程式或執行工作流程。

舉例來說,有人曾使用 OpenClaw 自動化交易。他們設計規則,並要求 AI 不只是提供建議(這是 ChatGPT 能做到的),而是實際下單執行交易。

為什麼 AI 代理人會帶來新的安全風險?

如前所述,AI 代理人會採取行動,而不僅僅是提供建議。這通常伴隨對檔案、應用程式或系統功能的存取權。

賦予 OpenClaw 的系統存取與自主性改變了可能的影響與風險。OpenClaw 會請求與軟體互動或執行例如發送郵件、填寫表單等動作的權限,而這些操作可能在沒有你監督的情況下進行。這使其行為具有不可預測性。

錯誤或被操縱可能造成真實的後果。風險不只是代理人被要求做什麼,而是它在執行任務時如何解讀所遇到的內容,並將其視為指令。

為何不受信任的輸入是核心問題

AI 代理人會消耗大量外部內容(例如網頁與文件)以決定下一步該做什麼,而這些內容並非總是可信的。

指令不必以明確命令的形式出現;它們可能隱藏在代理人在執行任務時讀取的文字或資料中。這使得攻擊者能在完全不與代理人直接互動的情況下,影響其行為。

這種情況為提示注入(prompt injection)創造了明確的攻擊路徑:攻擊者利用不受信任的輸入誘導代理人採取原本不該執行的行動。

強大的 AI 工具需要更嚴格的防護

AI 代理人可以存取檔案、電子郵件與系統功能。Kaspersky Premium 可協助偵測可疑活動、封鎖惡意腳本,並保護你的裝置免受真實世界的網路攻擊。

立即免費試用 Kaspersky Premium什麼是在 AI 代理人中的提示注入(prompt injection)?

提示注入是透過提供不受信任的內容來操縱 AI 代理人,從而改變其行為的一種手法。

這項風險並非程式碼上的技術缺陷,而是代理人可能會把外部輸入(例如即時訊息或留言)當作指令來處理。當情況如此時,代理人可能被誘導去執行原本不應執行的動作。

提示注入在真實場景中如何發生

提示注入可以是直接的,也可以是間接的。

- 直接型態——攻擊者刻意在代理人會讀取的內容中加入指示。

- 間接型態——代理人在執行正常任務時,從網站或訊息中拾取到隱藏或意外的指示。

關鍵在於行為。代理人可能會遵循其解讀為指引的內容,即便該內容來源並不受信任。這種情況不需要傳統的軟體漏洞即可發生。

為何提示注入對 AI 代理人比對聊天機器人更危險

對聊天機器人來說,注入的指令通常只會影響回應或建議;但對 AI 代理人來說,它們會影響實際行動。

如果代理人有檔案或系統控制的存取權,遭操縱的指示可能導致真實世界的變更。因此,提示注入對代理人構成更高的風險:同樣的技巧在聊天機器人中會改變文本輸出,但在代理人身上可能觸發未預期的操作。

什麼是 AI 代理人的持久記憶?

持久記憶讓 AI 代理人能夠隨時間保留資訊。也就是說,它可以利用過去的輸入來引導未來決策,而不是每次任務都從頭開始。

持久記憶對 AI 代理人意味著什麼

代理人可以在不同會話間儲存上下文與指示,並逐步形成偏好的「行為模式」。這有助於代理人記住先前學到或做過的事情,從而提高工作效率。

但這也代表先前的輸入會影響後續行為。先前任務中拾取的指示或假設,可能在不同情境下仍然左右代理人的決策,即便使用者已不再注意到這些影響。

為何持久記憶會增加資安風險

持久記憶可能引入延遲性的影響。惡意指令可能不會立即造成問題,但在條件吻合時會再次浮現。

這使得清除與修復更加困難。儲存的行為可能在多次任務中重複出現。要完全恢復安全狀態,往往需要清除記憶或重建設定,以確保不受歡迎的影響被移除。

當 AI 代理人未正確設定或暴露時會發生什麼?

代理人可能會以擁有者未曾預期的方式被存取或影響,使原本有用的工具變成潛在的安全風險。

這可能源自意外或誤解,也可能是第三方試圖操縱代理人時發生的情形。

AI 代理人如何在無意間被暴露

暴露通常源自簡單錯誤。像是弱密碼驗證或過度寬鬆的權限設定,都可能讓代理人從預期環境之外被存取。

在本地運行代理人並不保證安全。如果它連到網際網路或與其他系統互動,就可能被外界影響。本地控制能降低部分風險,但並非萬無一失。

為何被暴露的代理人會成為攻擊面

一旦暴露,代理人就成了攻擊者可以探測、測試與操縱的目標。他們可能嘗試餵入特製輸入、觸發行動或長期觀察其行為。

由於代理人能採取實際行動,濫用方式不必像傳統駭客手法那樣明顯。濫用可能包括操控行為、擷取資料或造成非預期的系統變更,而這些都不一定需要利用典型的軟體漏洞。

何謂 AI 代理人安全中的「致命三合一」?

「致命三合一」指的是三個共同發生時,會對 AI 代理人造成嚴重安全風險的條件。

促成重大攻擊的三個條件

- 第一個條件是能存取敏感資料,例如檔案、憑證或內部資訊。

- 第二個是存在不受信任的輸入,意即代理人會處理無法完全驗證的內容。

- 第三個是能採取外部行動,例如發送請求、修改系統或執行指令。

單獨看時,這些因素可能是可管理的;但當它們同時出現時就會產生危險。一個能讀取不受信任輸入且能對外採取行動的代理人,為操縱創造了明確路徑。因此,限制代理人可執行的行為至關重要。

現在一般使用者應該執行 AI 代理人嗎?

對大多數人來說,AI 代理人仍屬實驗性工具。在適當的環境下它們可以很有用,但缺點是它們也引入了不容易察覺的新風險。

什麼情況下使用 AI 代理人是合理的

在受控且低風險的情境下,使用代理人是有道理的。例如在獨立的測試裝置上實驗,或讓代理人處理非敏感任務(像是整理檔案或測試流程)。

假如你想用代理人幫你規劃行程,它可以存取相關資訊來完成任務,同時被限制不能直接聯絡他人或執行會造成重大損害的操作。

如果你能妥善管理設定且任何錯誤不會造成重大損失,代理人可以當作學習與自動化工具。關鍵在於把作用範圍縮小並嚴格限制存取權。

何時不該使用 AI 代理人

當代理人可以存取敏感資料或重要帳戶時,便不適合使用。若在不瞭解權限或外部輸入風險的情況下運行代理人,風險會迅速增加。

選擇不使用也是合理的。如果為了方便而必須犧牲安全或心安,那麼暫不使用 AI 代理人是明智的決定。

使用 AI 代理人時有哪些基本防護措施?

基本防護能降低風險並避免小錯誤演變成嚴重問題。

Kaspersky 的軟體可提供額外保護,透過標示可疑行為並協助防止帳戶被入侵。我們的 方案可阻擋從惡意軟體與病毒到勒索軟體與間諜程式等各類威脅。

最重要的安全措施有哪些

隔離原則至關重要。盡可能在獨立的裝置與帳戶上運行代理人,避免它們影響重要資料或系統。將權限限制在代理人真正需要的範圍;建議不要預設給予完整系統或帳戶存取權。

確認與授權步驟也很重要。在執行敏感操作前要求使用者確認,能在不經意的情況下阻止像是代為支付等嚴重錯誤。這類簡單的控制能以低複雜度達成高效益。

AI 代理人對消費者級 AI 的未來意味著什麼?

AI 代理人預示著工具不再只是在旁協助,而是會主動採取行動。但這個轉變伴隨的取捨,消費者才剛開始學習如何應對。

這個時刻告訴我們 AI 代理人成熟度到什麼程度

AI 代理人雖然很有能力,卻仍不成熟。它們能自動化任務,但在判斷與安全性方面仍有不足。這並不代表代理人不會變得更安全或更可靠,而是提醒我們對期待要保持現實。

代理人顯示了未來的發展方向,但要讓它們普及並成為日常工具,仍需要更好的防護措施與從一開始就以安全為設計核心的工具。

延伸閱讀:

推薦產品:

常見問答

OpenClaw 可以免費下載嗎?

OpenClaw 可在 Github 免費下載。它是開放原始碼軟體,代表任何人都可以修改並重新散佈程式碼。

OpenClaw 容易架設嗎?

市面上有教學能讓使用者快速上手並啟動機器人,但要做出穩健且複雜的設定仍需時間與專業知識。若軟體未被妥善設定,使用風險會更高。